【総務・情シス必見】社員の「私的AI利用」が招く情報漏洩リスクと、安全なツールの選び方

株式会社WELL(ウェル) 営業部

生成AIの進化と普及により、業務効率は大きく向上しています。

一方で、会社が許可していないAIツールを社員が個人的に業務中に利用してしまう「シャドーAI」が、新たなセキュリティリスクとして急増しています。

実はAI対策を進める企業ほど、別の重大なリスクを放置している可能性があります。

今回は、「AI経由の情報流出」のメカニズムと対策に加え、その陰で盲点となっている最も多い情報漏洩の原因について解説します。

なぜ起こる?「シャドーAI」の典型的なシナリオ

生成AIの利用が広がる中で、企業が意図しない形でのAI利用、いわゆる「シャドーAI」が増えています。

これは、特別な知識や悪意がある人だけが利用しているわけではなく、日常業務の延長で利用されているため、誰にでも起こり得る問題です。

実際の現場では、「少し便利にしたい」「効率を上げたい」という軽い動機から、気づかないうちにリスクのある使い方が広がっていきます。

特に多く見られる典型的なシナリオを紹介します。

会社支給ツールと個人利用のギャップ

企業としては、セキュリティが担保されたAIツールを正式に導入しているケースも増えています。

しかし現場では、「使い慣れている」「無料で手軽に使える」といった理由から、社員が個人アカウントで別のAIツールを利用してしまうことがあります。

例えば、会社では法人向けのAIサービスが提供されているにもかかわらず、ブラウザから個人の無料アカウントにログインし、業務内容を入力してしまう、といったケースです。

この背景には、会社が用意した環境と、個人の使いやすさとの間にあるギャップがあります。

ルールとして禁止されていても、「少しだけなら問題ないだろう」という認識が、無意識の利用につながってしまうのです。

リテラシー不足による「機密情報の入力」

もう一つの大きな要因が、「どこまでが入力してよい情報なのか」の認識不足です。

AIはあくまでツールですが、その仕組みを十分に理解しないまま使うことで、本来は外部に出してはいけない情報を、そのまま入力してしまうケースが見られます。

例えば、議事録の要約や企画書作成を効率化しようとして、顧客名や取引内容、未公開のプロジェクト情報などをそのままプロンプトに含めてしまうといったケースです。

本人に悪意はなく、「業務を早く終わらせたい」という善意からの行動であっても、結果として情報漏洩のリスクを高めてしまう可能性があります。

「便利に使うための一手間」が、リスクの入口になる。これが、シャドーAIの最も注意すべきポイントです。

最大のリスクは「AIの学習データ」への利用

シャドーAIにおける最大のリスクは、入力した情報がその場限りで終わらない可能性があることです。

多くの生成AIは、ユーザーの入力内容をもとに応答を生成するだけでなく、サービスの品質向上やモデルの改善のためにデータを活用する仕組みを持っています。

そのため、業務で扱う機密情報や個人情報を不用意に入力してしまうと、その情報が意図しない形で外部に流出する可能性があります。

「AIに入力する=社外に渡す可能性がある」この前提を持つことが重要です。

無料版AIの利用規約に潜む罠

特に注意が必要なのが、個人向けに提供されている無料版のAIツールです。AIサービスの多くは利用規約の中で「入力されたデータをサービス改善やモデル学習に利用する場合がある」といった内容が明記されていることが多く見られます。

一方で、この規約を細かく確認せずに利用しているユーザーも少なくありません。

その結果、本人は「ただ便利に使っているだけ」のつもりでも、企業としては情報を外部に提供している状態になっているというギャップが生まれます。

無料で使える便利さの裏側には、「データの取り扱いは自己責任になる」という前提があることを理解しておく必要があります。

情報流出のメカニズム

では、実際にどのように情報漏洩が起きるのでしょうか。

例えば、A社の社員が業務効率化のために、社外秘の情報を含む内容をAIに入力したとします。

その情報がサービス側で蓄積・活用されることで、後日、別のユーザーが類似の質問をした際に、その一部が応答の中に反映されてしまう可能性があります。

もちろん、すべてのサービスで明確にそのような挙動が起きるわけではありませんが、「完全に閉じた環境ではない」以上、リスクはゼロではないという点が重要です。

情報漏洩は誰かが盗むのではなく、仕組みの中で起きる可能性があるということを忘れてはいけません。

【フラットに比較】安全なAI利用のためのツール選び

シャドーAIによるリスクを防ぐためには、 「使うか・使わないか」ではなく、“どう使うか”を設計することが重要です。

その中でも大きな分かれ目となるのが、 利用するAIツールの種類と契約形態です。ここでは、安全にAIを活用するための代表的な選択肢を、フラットな視点で整理します。

法人向け(エンタープライズ)プランの活用

企業での業務利用においては、各社が提供している法人向けプランの活用が基本となります。これらのプランでは、一般的に業務利用を前提とした設計です

- 入力データを学習に利用しない

- 管理者による利用状況の把握が可能

- セキュリティポリシーの統制ができる

そのため、機密情報を扱う可能性がある業務においては、 個人向けサービスではなく、法人契約を前提とすることが重要です。

無料ツールでの自衛手段(オプトアウト機能)

一方で、個人向けのAIツールであっても、設定によってデータの学習利用を制限できる場合があります。

いわゆる「オプトアウト機能」を利用することで、 入力内容がモデルの学習に使われないようにすることが可能です。

ただし、この方法には注意点があります。

- 設定変更が各個人任せになる

- 初期設定のまま使われるリスクがある

- 全社員への徹底が難しい

「できる」と「運用できる」は別問題です。そのため、企業としてのリスク管理という観点では、

この方法だけに依存するのは現実的とは言えません。

【注目ツール】学習されないLLM「NotebookLM」の活用

近年では、入力データをモデル学習に利用しないことを前提としたAIツールも登場しています。その一つが、Googleが提供する「NotebookLM」です。

このツールは、ユーザーがアップロードした資料(ソース)をもとに回答を生成する仕組みで、その内容が外部の学習データとして利用されることはありません。

「閉じた環境でAIを使う」という発想に近いツールです。社内資料や議事録、調査データなど、機密性の高い情報を扱う場面においては、有効な選択肢の一つと言えるでしょう。

企業が今すぐやるべき「AI利用ガイドライン」の策定

シャドーAIによる情報漏洩を防ぐために重要なのは、単にツールを制限することではなく、企業としての“使い方のルール”を明確にすることです。

現場の利便性とセキュリティを両立させるためには、

曖昧な注意喚起ではなく、誰もが判断できる具体的なガイドラインが求められます。

「全面禁止」は逆効果

生成AIは、すでに多くの業務で活用されている便利なツールです。そのため、利用を全面的に禁止してしまうと、現場では「隠れて使う」動きが生まれやすくなります。

シャドーIT化が進み、企業側が把握できない状態での利用が増えることこそが最大のリスクです。

重要なのは「禁止」ではなく、安全に使える範囲を定義することです。

「入れてはいけない情報」を明確に定義する

AI利用において最も重要なのは、「何を入力してはいけないのか」を明確にすること。

例えば、以下のような情報は原則として入力禁止とする必要があります。

- 個人情報(氏名・住所・連絡先など)

- 顧客データ・取引情報

- 未公開の事業計画・プロジェクト情報

- ソースコードや設計情報

- 財務データ・契約内容

ポイントは、判断を個人に委ねないことです。「これは大丈夫だろう」という個々の判断が、リスクの入口になります。

誰でも同じ判断ができるよう、基準を明確にして社内に周知を行うことが不可欠になります。

社内リテラシー教育の徹底

ルールを作るだけでは、実際のリスクは防げません。そのルールが「なぜ必要なのか」を社員一人ひとりが理解することが重要です。

特に重要なのは、 「入力した情報がどのように扱われるか」という仕組みの理解です。

- AIは外部サービスであること

- 入力情報が蓄積・活用される可能性があること

- 完全に閉じた環境ではないこと

これらを具体的に伝えることで、単なるルールではなく、自分ごととしての意識に変わっていきます。

「知らなかった」による漏洩を防ぐことが、最大の対策と言えます。

AI時代に増えている「見えないリスク」の正体

生成AIやクラウドの活用が進み、企業のデータ管理は大きく変化しています。一見すると、情報はより安全に、効率的に扱われているように見えます。

しかし実際には、デジタル化が進んだからこそ生まれている新たなリスクがあります。それが、「デジタルと紙が混在する二重構造」です。

なぜ「持ち出し」がリスクになるのか

ここで重要なのが、現在の業務環境です。

AIやクラウドで作成・管理された情報が、 最終的に紙として出力されるケースは依然として多く存在します。

- AIで作成した資料を印刷

- デジタルで管理している情報を紙で共有

- 電子化後も原本を保管

その結果 デジタルと紙の「二重構造」が生まれ、最も弱い部分にリスクが集中します。

・会議資料をそのまま持ち帰る

・不要書類をまとめて廃棄しようとして移動させる

・シュレッダー待ちの書類を一時的に保管する

これらはすべて「特別な行動」ではなく、日常の延長です。そして重要なのは、リスクは「処理のタイミング」ではなく、「持ち出した瞬間」に発生します。

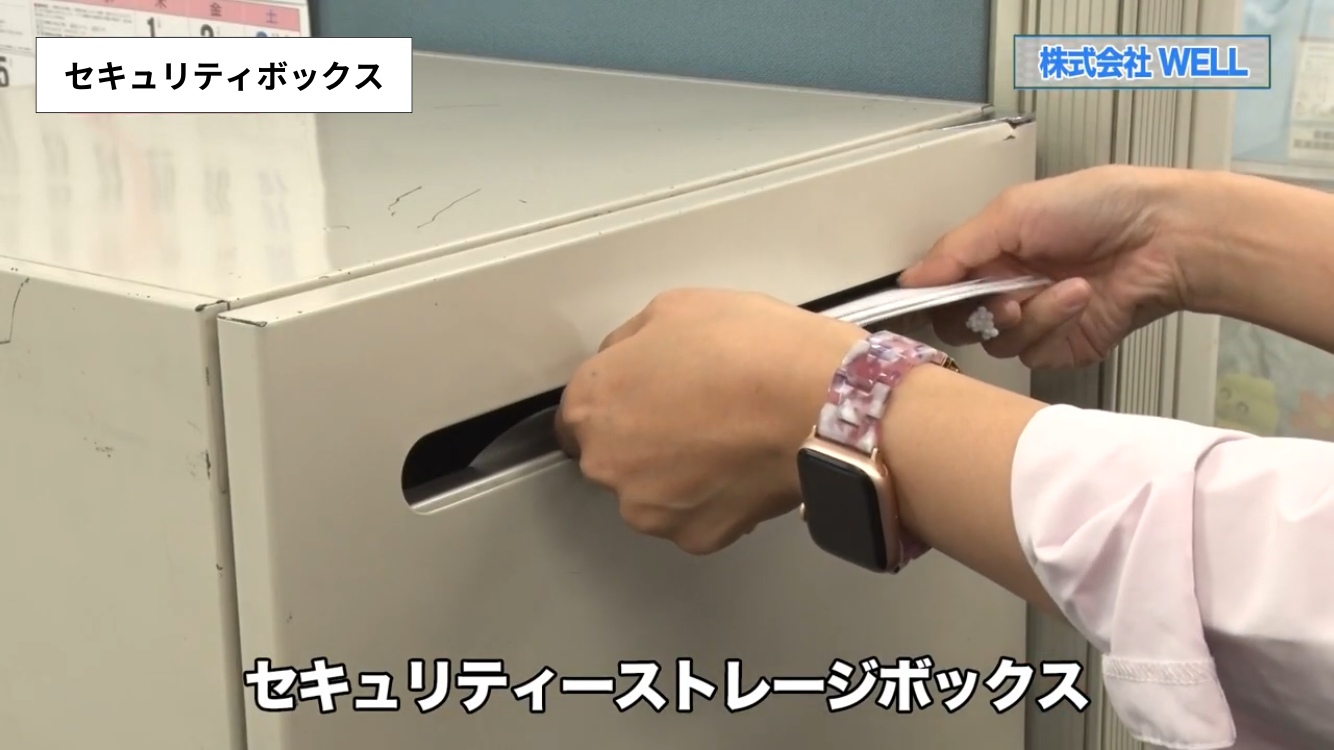

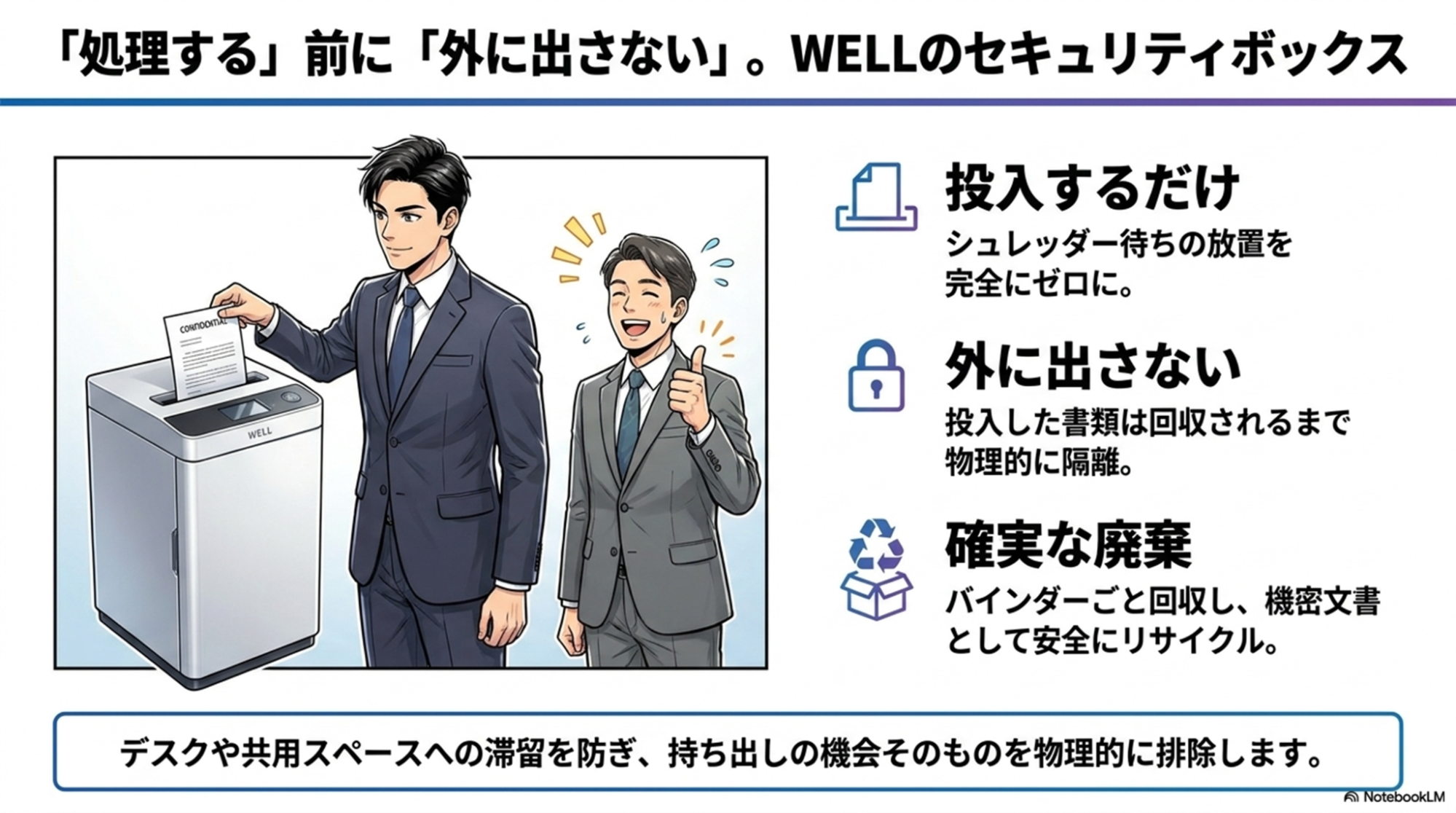

セキュリティボックスで「外に出さない」運用へ

こうしたリスクを防ぐには、機密書類を「適切に処理する」前に、そもそも外に出さない仕組みが必要です。

こうしたリスクを防ぐには、機密書類を「適切に処理する」前に、そもそも外に出さない仕組みが必要です。

その具体策として有効なのが、セキュリティボックスの活用です。オフィス内に専用ボックスを設置し、不要書類をその場で投入する運用にすることで、書類がデスクや共用スペースに滞留することを防ぎます。

また、一定量たまった段階で回収・処理を行うことで、シュレッダー待ちによる放置や、持ち出しの機会そのものを減らすことができます。

「処理する」前に、「外に出さない」設計へ。

結論:「人」ではなく「仕組み」で防ぐ

情報漏洩対策は、個人の注意や意識だけに依存すると限界があります。重要なのは、誰が使っても同じように安全が担保される仕組みとしての運用を整えることです。

セキュリティボックスの導入は、機密書類の管理を個人任せにしないための有効な手段の一つです。

企業が本当に守るべきものは、デジタルデータか紙かではなく、「情報そのもの」。

AIやサイバー対策を強化しても、紙の管理・廃棄が不十分であれば、情報漏洩のリスクは残り続けます。セキュリティは「最も弱い部分」から崩れる。

その弱点が、今もなお紙の運用に残っているケースは少なくありません。「持ち出させない仕組み」をつくることが、最も確実な対策です。

まとめ

WELLでは、シュレッダー待ちの放置をなくす「セキュリティボックス」やバインダーごとダンボール箱を回収して処理する機密文書リサイクルなどを通じて、情報漏洩の最大の原因となる『紙媒体』の確実な廃棄をサポートします。

オフィスの物理セキュリティに課題を感じている場合は、デジタル対策を無駄にしないためにも、紙の廃棄フローを見直してみてはいかがでしょうか。

株式会社WELL(ウェル) 営業部

ビジネスの中で廃棄される機密書類や、不要になった古紙などを、迅速な回収、安全な再資源化を行なう機密書類処理のリーディングカンパニーの営業部です。